الاستخدام الآمن للذكاء الاصطناعي يتطلب تحقيق توازن دقيق بين الابتكار والمسؤولية الأخلاقية. في عالم يتسارع فيه تقدم الذكاء الاصطناعي، يصبح من الضروري معالجة المخاطر المحتملة مثل الأمن الإلكتروني، التحيز، وفقدان الوظائف. لتحقيق هذا التوازن، يجب تطبيق إجراءات وقائية مثل الشفافية في عمل الخوارزميات، وضع قوانين ولوائح تنظيمية لحماية البيانات، وتثقيف الجمهور حول حدود وفوائد الذكاء الاصطناعي. بالإضافة إلى ذلك، يجب تشجيع تطوير أدوات وممارسات اختبار مستقلة لتقييم استقرار وأمان نماذج الذكاء الاصطناعي قبل نشرها. من خلال هذه التدابير، يمكن إدارة طاقات الذكاء الاصطناعي بحكمة واحترام للمبادئ الأخلاقية والقانونية، مما يؤدي إلى مجتمع أكثر شمولاً وتقدماً باستخدام تكنولوجيا الذكاء الاصطناعي بكفاءة وبأقل قدر ممكن من الخطر السلبي.

إقرأ أيضا:الدارجة المغربية : الدّحاسمقالات قد تكون مفيدة من موسوعة دار المترجم:

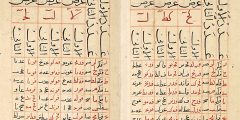

- هل القرآن محفوظ باللفظ والمعنى أم بالمعنى فقط؟ وما سبب اختلاف بعض الكلمات بين الروايات؟.

- Sarve

- أثابكم الله فضيلة الشيخ سؤالي: كيفية صلاة النبي صلى الله عليه وسلم الجهرية والسرية وما يقول في كل رك

- ذكرتم في إحدى الإجابات: فإنما قمت به من إكمالك الصلاة بعد ما تذكرت الزيادة وسجودك للسهو كان صواباً،

- Mathematical model (disambiguation)